大企業の人事評価において最も深刻な課題は、マネージャーの主観による「無意識の偏見(アンコンシャス・バイアス)」と、それによる「評価の甘辛のばらつき」です。

全社共通の立派な評価基準(コンピテンシーディクショナリーなど)が存在していても、数百人のマネージャーがそれを完全に同じ解釈で運用することは不可能です。「あの部署はいつも評価が高い(甘い)」「うちの課長は絶対に最高評価をつけない(辛い)」といった不公平感は、優秀な社員から「ここでは正当に評価されない」という絶望を生み、離職の直接的な引き金となります。

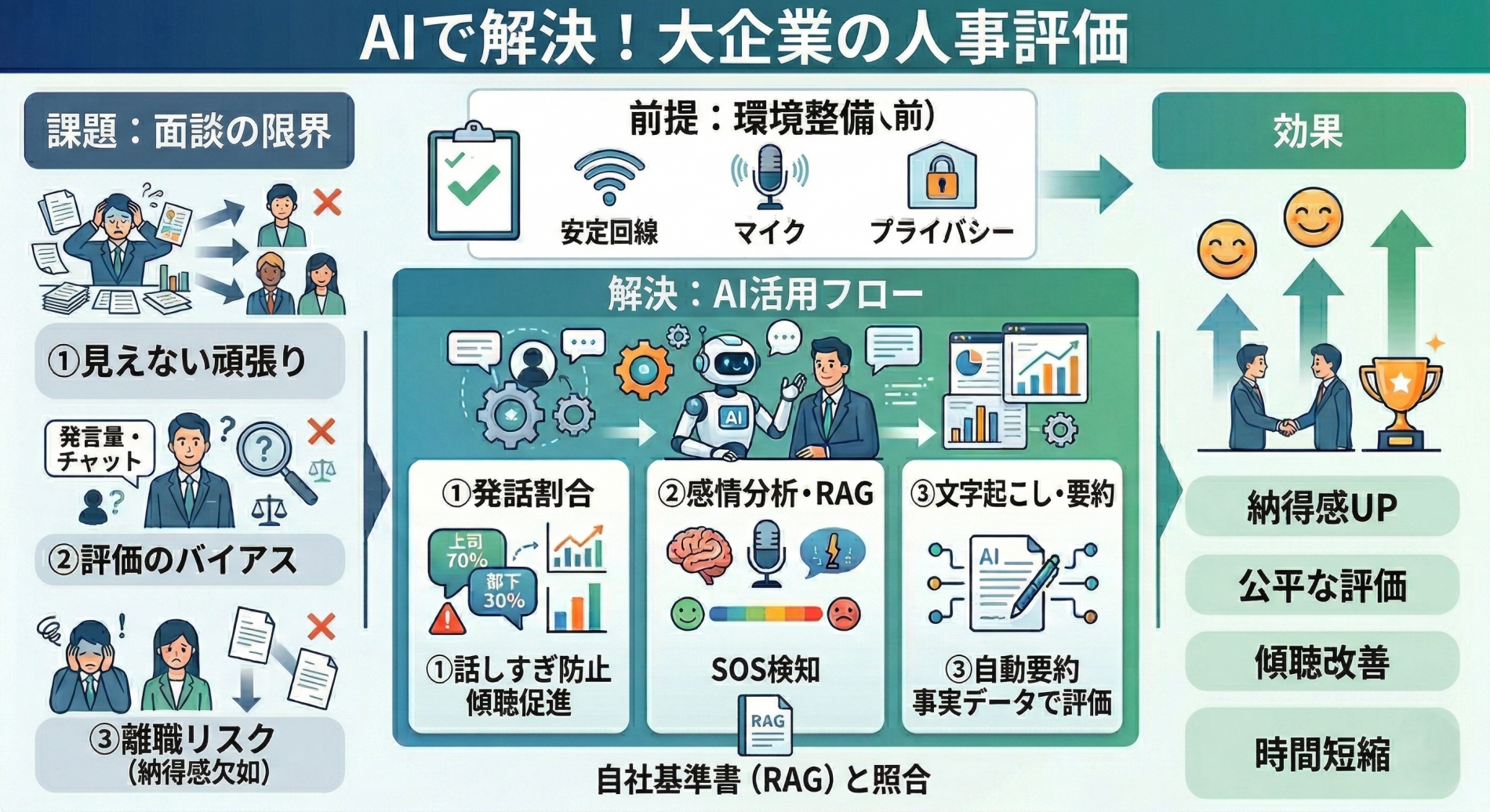

最新の人事評価AIは、単に「文章を読んで点数をつける」ようなブラックボックスな仕組みではありません。現在主流となりつつあるのは、自社独自の評価マニュアルをAIに読み込ませる「RAG(検索拡張生成)」技術を活用した手法です。

現場のマネージャーが実際に使用するダッシュボード(UI)の具体的な運用イメージは以下のようになります。

大企業には数十ページに及ぶ独自の評価基準書が存在します。RAG技術を用いることで、AIは「世間一般の基準」ではなく、「自社の等級要件」に限定して思考します。マネージャーが部下の期末レポートや1on1の記録を入力すると、AIは即座に基準書と照合し、「この行動事実は、自社の等級要件4の『他部署を巻き込んだ課題解決』の定義に合致しています」という事実ベースの分析を返します。

マネージャーがシステム上で「B評価(標準)」と入力しようとした際、AIが過去の行動ログやテキストを解析し、ダッシュボード上にアラートを出します。「入力された事実データは『A評価』の基準を満たしている可能性が高いです。あなたの評価は基準より厳しすぎる(辛い)傾向にありませんか?」このように、AIは評価を決定するのではなく、マネージャーのバイアスに客観的な「ツッコミ」を入れる壁打ち相手(キャリブレーション・パートナー)として機能します。

AIを人事評価というセンシティブな領域に導入する際、人事担当者が最も懸念すべき2つのリスクとその具体的な対策(一次情報としての知見)を解説します。

AIが入力されていない事実を勝手に推測し、「この社員はリーダーシップを発揮した」と捏造してしまうリスクです。

・実務上の対策:プロンプトエンジニアリングにおいて「推測や一般論の生成を固く禁じる」「入力されたログ(事実)のみを抽出し、評価基準書の一致箇所のみを出力する」という制限を厳格にかけます。これにより、AIを「生成器」ではなく「高度な照合ツール」として扱います。

「過去に高評価を得たのは男性や特定部門の出身者が多かった」という過去の評価データをAIにそのまま機械学習させると、AI自体が「男性や特定部門を高く評価する」という差別的なバイアスを引き継いでしまいます。

・実務上の対策:過去の「評価結果」をAIに学習させるのではなく、前述のRAG技術を用いて「評価のルールブック(基準)」のみを参照させる設計にします。属人的な過去の歴史からAIを切り離すことが、真の公正性を担保する絶対条件です。

私たちが多くの大企業の採用・評価DXを支援してきた中で、最大の壁となるのは「機械に部下を評価されたくない」「自分のマネジメントを否定されたくない」という現場管理職からの強烈な反発です。これを乗り越えるための「失敗しないあるあるノウハウ」をご紹介します。

・「評価者」ではなく「マネージャーの防具」として位置づける

システム導入時の社内説明会で「AIが評価を適正化します」と言うと必ず反発を招きます。そうではなく、「AIは、部下から『なぜこの評価なんですか?』と不満を出された際の、客観的な証明データ(防具)になります」と伝えます。マネージャーを守るためのツールであると認識させることで、現場の納得感は劇的に高まります。

・スモールスタートと「甘辛補正」の裏側

運用最初は全社一斉に導入せず、特定の部門からスモールスタートします。また、初期段階ではマネージャーの画面にAIのアラートを直接出さず、人事部門のダッシュボードでのみ「甘辛のばらつき」を可視化し、人事が個別でマネージャーにヒアリングを行う「裏側でのキャリブレーション運用」から始めるのが安全な定着のセオリーです。

実際にAI(RAGや自然言語処理)を導入し、大規模組織における評価課題を解決している実在の企業(※特定を避けるため抽象化)の運用傾向をご紹介します。

ある数千人規模の製造業では、数百の部署で評価基準が形骸化し、期末の評価調整会議(キャリブレーション会議)が紛糾して膨大な時間を消費していました。そこで、自社の評価マニュアルを読み込んだAI評価アシスタントを導入。マネージャーが部下の実績を入力すると、AIが「基準書に基づく推奨グレードとその根拠」を自動提示する仕組みを構築しました。

結果として、マネージャーが主観や感情を排した「事実ベースの評価シート」を作成できるようになり、人事部門と部門長が行う評価調整会議の時間が大幅に削減。全社で統一された公正な評価プロセスが確立され、従業員アンケートでも「評価の納得感」に関するスコアが目に見えて改善する傾向を示しています。

A. AIは入力されていない情報(見えない努力)を評価することはできません。だからこそ、日々の1on1のメモや、部下からの自己申告テキストなど「定性的な行動事実を言語化してシステムに入力する」プロセスが重要になります。事実さえ入力されれば、AIはそれを評価基準と照らし合わせて公平に拾い上げます。

A. 従来のようなフルスクラッチ開発(自社専用のシステム構築)に比べ、現在は既存のタレントマネジメントシステムに社内ドキュメントを読み込ませるオプションが普及しており、コストは年々低下しています。評価会議にかかっていた膨大な人件費や、優秀な人材の離職コストを考慮すれば、十分な投資対効果が得られます。

大企業における人事評価面談の「ばらつき」と「不透明さ」は、RAGなどの最新AI技術を活用することで、極めて現実的かつ実務レベルで解決できる時代(2026年)に突入しています。

重要なのは、AIのハルシネーションやバイアスといったリスクを正しくコントロールし、現場のマネージャーの反発を招かない「人間中心の運用設計」を行うことです。AIが客観的な基準との照合を行い、マネージャーがそのデータをもとに部下と深く対話する。このハイブリッド運用こそが、大企業に求められる真の公正性です。

自社の複雑な評価プロセスをどうAIに学習させ、現場に定着させるべきか。具体的なシステム設計のポイントや、経営陣・現場を説得するための社内向け説明資料の作り方をまとめた実践ガイドをご用意しています。

▼ AIのハルシネーションや現場の反発を防ぎ、全社で統一された公正な評価体制を構築する実務ノウハウはこちら

AIさくらさん(澁谷さくら)

ChatGPTや生成AIなど最新AI技術で、DX推進チームを柔軟にサポート。5分野のAI関連特許、品質保証・クラウドセキュリティISOなどで高品質を約束します。御社の業務内容に合わせて短期間で独自カスタマイズ・個別チューニングしたサービスを納品。登録・チューニングは完全自動対応で、運用時のメンテナンスにも手間が一切かかりません。